何を演奏するかではなく、どう演奏するかである: 音色は音楽における感情知覚に影響する

原題: It’s not what you play, it’s how you play it: Timbre affects perception of emotion in music

顕著な感覚経験はしばしば強い情動的な色合いを帯びているが、感覚対象の知覚的特徴と、それが伝える感情情報との神経心理学的関係は、いまだ十分には定義されていない。そこで本研究では、音の同一性と感情情報との関係を音楽を用いて検討した。2つの実験において、他の音楽的特徴とは独立に、音楽がどの楽器で演奏されるかを変えることで感情知覚が影響を受けるかどうかを調べた。

第1実験では、4つの感情のいずれか1つを表す40個の新規メロディを、4種類の異なる楽器(電子シンセサイザー、ピアノ、ヴァイオリン、トランペット)でそれぞれ録音し、楽器間でメロディ、テンポ、音量を統制した。健常参加者(18〜30歳の若年成人23名、58〜75歳の高齢成人24名)は、4択の強制選択課題で、各音楽刺激がどの感情を表すと思うかを選択した。一般化線形混合モデルを用いた結果、若年群・高齢群のいずれにおいても、楽器と感情判断の間に有意な交互作用が認められた(各年齢群とも p < .0001)。この効果は音楽的熟達性では説明されなかった。

第2実験では、同じメロディと実験デザインを用い、特定の感情に結びつく音色手がかりを取り入れるよう設計した新規の合成音色を用いて、別の若年成人群で音色と知覚感情の交互作用が再現された(p < .05)。本研究の知見は、音色(楽器同一性)が、他の音響的・認知的・演奏上の要因を統制したうえでも、音楽における感情知覚に独立して影響することを示している。

連絡先: J. D. Warren, Dementia Research Centre, Institute of Neurology, University College London, Queen Square, London, WC1N 3BG, UK. E-mail: jwarren@drc.ion.ucl.ac.uk

参加してくれたボランティアの方々に感謝する。トランペット刺激の録音を担当したロンドン音楽大学の Jonas Brolin 氏、人工音色合成のための Matlab スクリプト作成を支援したニューカッスル・アポン・タイン大学の Tim Griffiths 教授にも謝意を表する。本研究は Wellcome Trust、UK Medical Research Council、Alzheimer Research Trust の支援を受けた。R.O. は Royal College of Physicians/Dunhill Medical Trust Joint Research Fellowship の支援を受け、J.D.W. は Wellcome Trust Intermediate Clinical Fellowship の支援を受けた。Dementia Research Centre は Alzheimer’s Research Trust Coordinating Centre である。本研究は University College London において実施され、同大学は Department of Health の National Institute for Health Research (NIHR) Biomedical Research Centres funding scheme から一部資金提供を受けた。

© 2009 The Experimental Psychology Society / DOI: 10.1080/17470210902765957 / http://www.psypress.com/qjep

キーワード: 音色、感情、音楽、聴覚オブジェクト

序論

私たちの最も顕著な感覚経験は、しばしば強い情動的色彩を帯びている。しかし、感覚対象の知覚的特徴と、それらが運ぶ感情情報との神経心理学的関係は、十分に定義されていない。音楽はこの問題に関係する刺激である。なぜなら、音楽には楽器や旋律といった多様で特徴的な聴覚オブジェクトが含まれ、さらに多くの聴き手にとって音楽の感情的内容がその最も重要な属性だからである(Blood & Zatorre, 2001; Dalla Bella, Peretz, Rousseau, & Gosselin, 2001; Sloboda & O’Neill, 2001)。音楽はまた、比較的明確に定義された構造的知覚特徴をもち、それらを比較的単純かつ独立に操作できるという点でも有用な刺激である。健常な聴き手は、特定の楽曲の感情内容について高い一致率を示すことができ、音楽の構造的特性を変えることで、その感情価を信頼できる形で変化させられることが示されている(Gabrielsson & Juslin, 1996; Juslin, 1997; Robazza, Macaluso, & Durso, 1994; Terwogt & Van Grinsven, 1988)。

人に対する病変研究や機能的画像研究では、音楽感情の処理に、さまざまな文脈で強い感情を処理することに関与する中脳辺縁系およびその他の脳領域が関わることが示されている(Blood & Zatorre, 2001; Gosselin, Peretz, Johnsen, & Adolphs, 2007; Menon & Levitin, 2005; Peretz, Gagnon, & Bouchard, 1998)。これは、抽象的な性質をもつにもかかわらず、音楽が、生きた感覚対象の感情処理に類似した神経機構を動員することを示唆している(Dalla Bella et al., 2001; Juslin & Laukka, 2003)。したがって音楽は、知覚特徴の操作が感覚刺激の感情内容にどのような影響を及ぼすかを研究するうえで、有望なモデルとなりうる。

音楽作品の最も基本的で、かつ広く研究されてきた構造特徴は、旋律を構成する音高列である。健常な聴き手は、「幸福な」旋律と「悲しい」旋律を信頼して区別でき(Dalla Bella et al., 2001; Robazza et al., 1994; Terwogt & Van Grinsven, 1988)、旋律線に含まれる音高操作によって、幸福と悲しみの感情表出が変化しうる。さらに、音量、ビブラート、テンポ、リズム、旋法、和声(協和-不協和)など、旋律以外の多くの構造的特徴も、感情の心理生理学的相関(Sloboda, 1991)や、音楽における幸福・悲しみ・その他の基本感情の判断に影響することが示されている(Gabrielsson & Juslin, 1996; Juslin, 1997; Peretz et al., 1998)。

音楽感情の表出においては、どの楽器、あるいはどの楽器編成を選ぶかもまた重要である(Balkwill & Thompson, 1999; Behrens & Green, 1993; Gabrielsson, 2001; Gabrielsson & Juslin, 1996; Juslin, 1997)。作曲家は、特定の感情的性質を伝えるために、意識的または直感的に特定の楽器を選ぶ。たとえば《新世界より》における物悲しいコール・アングレの独奏や、《ピーターと狼》における滑稽なファゴットのパートは印象的な例であり、同様の例はあらゆるジャンルの音楽に数え切れないほど存在し(Copland, 1957; Gabrielsson & Juslin, 1996; Sloboda & Juslin, 2001)、音楽文化を超えて見いだされる(Jackendoff & Lerdahl, 2006; Schneider, 2001)。

楽器の同一性を伝えるのが音色である。音色は操作的には、音高・持続時間・強度が同一である2つの音を区別する音響特性と定義され、楽器、声、環境音を含むあらゆる種類の聴覚オブジェクトの同定に不可欠である(Bregman, Levitan, & Liao, 1990; Griffiths & Warren, 2004; McAdams & Cunible, 1992)。音色は、スペクトル包絡、時間包絡(アタック)、スペクトルフラックス(スペクトル特性と時間特性の動的相互作用)など、いくつかの異なる次元から成る複雑な特性である(Caclin, McAdams, Smith, & Winsberg, 2005; McAdams, 1993)。

理論的には、音色は、楽器のような聴覚オブジェクトの特徴的な構造特性と、そのオブジェクトの感情内容とを結びつける重要な接点を占めうる。人の心理物理学研究では、楽器音色が音楽における感情判断に寄与することが示されており(Balkwill & Thompson, 1999)、電気生理学的証拠からは、音楽的感情表出の変化が単音レベルで検出されうることも示唆されている(Goydke, Altenmuller, Moller, & Munte, 2004)。アタックや周波数スペクトルといった音色の側面は、音楽中の特定感情の知覚に寄与する(Gabrielsson & Juslin, 1996; Juslin, 1997)。この証拠は、音色特徴が、旋律その他の手がかりから独立して、あるいはそれらが欠けている場合に、少なくとも部分的には音楽の感情内容を規定しうることを示している。

人の病変研究も、音色と感情の相互作用を支持している。非優位半球の後上側頭葉領域の急性損傷後には、比較的選択的な音色知覚障害が生じ、そのような患者はしばしば、音楽に対する快の喪失や情動反応性の低下を訴える(Kohlmetz, Muller, Nager, Munte, & Altenmuller, 2003; Stewart, von Kriegstein, Warren, & Griffiths, 2006)。音色は音楽・声・環境音を含む異なる種類の音に共通する一般的属性であるため、音や他感覚モダリティの対象特徴が感情認識に影響することを可能にする、一般的な機序を同定する手がかりにもなりうる。

しかし、音楽における知覚感情に対する音色変化の特異的効果を切り出すためには、旋律、テンポ、ダイナミックレンジ、音域、馴染みのある音楽に基づく学習済み連想などの構造特徴を統制する必要がある。そこで本研究では、健常参加者による旋律の感情同定が、他の音楽的特徴とは独立に、その旋律を担う音色(楽器)によって影響を受けるかどうかを検討した。本研究の設計にあたっては、感情知覚の構造的手がかり、馴染み、音楽的背景、曝露、さらに人間の演奏変数の役割といった、これまで純粋な音色効果の解釈を混乱させてきた要因を統制したうえで、音色の役割を評価することを特に重視した。

音楽の構造的特徴を統制し、特定の既知の楽曲との学習済み連想を最小化するため、新しいメロディ群を作成した。2つの実験を行った。第1実験では、西洋の聴き手の多くにとって馴染みのある楽器で旋律を提示し、若年成人と高齢成人の2つの年齢群を調べた。高齢成人を含めたのは、異なる音楽曝露や生涯発達の過程を通じても音色効果が安定しているかを評価するためである。高齢成人は他の認知的音楽課題で成績低下を示すことが知られており(Dowling, Bartlett, Halpern, & Andrews, 2008)、日常的な音楽聴取においてより否定的な感情反応を示すことも報告されている(Sloboda & O’Neill, 2001)。また年齢コホートによって生涯にわたる音楽経験が異なるため、特定の楽器と、それが通常伝える感情との間に異なる連想パターンを学習している可能性がある。

さらに、顔表情認識(Calder et al., 2003; Fischer et al., 2005)や音声感情認識(Ruffman, Henry, Livingstone, & Phillips, 2008)では加齢による低下が報告されており、特定感情やモダリティに対する年齢関連の相互作用が存在する可能性もある(Ruffman et al., 2008)。このことは、加齢それ自体が音楽感情知覚に影響する可能性を示唆する。第2実験では、旋律はもっぱら合成音色で提示された。これらの新規「楽器」は、特定感情に結びつく音色手がかりを組み込み、実在楽器に対する学習済みの感情連想による交絡や、人間の演奏手がかりを最小限に抑えるよう設計した。研究は地域研究倫理委員会の承認を得ており、すべての参加者はヘルシンキ宣言の原則に従ってインフォームド・コンセントを与えた。

実験1

本研究では、真に感情的に「中立」なメロディを作ることは難しく、日常の聴取において音楽は一般に感情的な色合いを帯びているため、明確な感情トーンを伝えることを意図して新規メロディを作曲した。より抽象的な感情状態ではなく基本感情を選んだのは、Ekman (1992) による顔表情の感情知覚に関する基礎研究に整合するためであり、これらの感情が健常者によって普遍的に認識され、かつ音楽で表現可能だからである。メロディは、現在広く用いられ、音楽訓練のない聴き手でも以前に耳にした可能性が高い楽器で演奏された。また、音色が知覚感情に及ぼす効果が、音楽訓練や現在の聴取頻度の個人差に対して頑健かどうかも明らかにしようとした。音楽聴取経験の影響は、若年成人と高齢成人という2つの年齢コホートを用いてさらに検討した。これらの年齢群は、ポピュラーソングやその他の現代音楽で使われる楽器について、さまざまな特定の感情連想を形成している機会があったと考えられる。

方法

参加者

聴覚症状や神経学的・精神医学的疾患の既往のない健常ボランティアを募集した。参加者は2つの年齢範囲から成り、若年成人は18〜30歳(n = 23、女性12名、平均年齢24.7歳、SD = 3.0)、高齢成人は58〜75歳(n = 24、女性14名、平均年齢66.7歳、SD = 5.2)であった。参加者に職業音楽家はいなかった。すべての参加者は質問紙に回答し、正規の音楽訓練(器楽または声楽)の経験と、現在1週間に能動的に音楽を聴く時間数の推定値を申告した。これらの回答は、参加者の音楽訓練水準と現在の音楽曝露を示す指標として用いた。参加者の音楽的背景と聴取経験にはかなりのばらつきがあったが、参加者の大半(若年群23名中14名、高齢群24名中20名)は、西洋クラシック音楽を日常的に聴いていると回答した(参加者特性の完全な要約は要請に応じて提供可能)。

刺激の作曲

新規メロディは、幸福、悲しみ、怒り、恐れの4感情のいずれかを表現するよう作曲された。著者の1人(J.C.H.)が、西洋音楽理論を用いて、8小節(4小節句を2つ)から成る単旋律メロディを合計80曲作成した。各感情につき20曲ずつである。メロディはト音記号の2オクターブ範囲内で作られ、規則的な拍動を持ち、長調・短調および複数の拍子を含んでいた。このプールから、著者ら(J.C.H., R.O., S.M.D.H., J.D.W.)の独立評価に基づいて、各ターゲット感情を最もうまく表した10曲ずつを最終刺激セットとして選んだ。著者ら自身はその後の実験には参加していない。

選択されたメロディの特徴を表1に示す。4つの例示メロディの記譜は図1に示し、すべてのメロディは要請に応じて提供可能である。旋法、調、テンポ、リズム、拍子、ダイナミックレンジは感情カテゴリ間で変化していた。これは、これらの構造的音響要因が音楽における特定感情の表現に重要な役割を果たすと考えられるためである(Dalla Bella et al., 2001; Gabrielsson & Juslin, 1996; Juslin, 1997; Peretz et al., 1998)。感情カテゴリ間で平均テンポには差があったものの、幸福・怒り・恐れカテゴリーの個別刺激のテンポにはかなりの重なりがあり、悲しみと恐れのテンポにも重なりがあった。40曲のうち15曲は、異なる感情を表す少なくとも1曲と同じ音高パターンを含んでいた。こうした共有音高構造の大半(15曲中12曲)は「幸福」メロディと「悲しみ」メロディの間で生じており、ターゲット感情は旋法、テンポ、リズムを変えることで表現された。これらの「反復」メロディは、予備評価に基づいて特定感情の表現に成功していたため含めたものであり、本研究は感情条件間で音高構造の反復が及ぼす効果を評価するようには設計されていない。

| 構造特性 | 下位項目 | 幸福 | 悲しみ | 怒り | 恐れ |

|---|---|---|---|---|---|

| 調性 | 旋法 | 長調 | 短調 | 短調 | 短調 |

| 調性 | 半音階的音数 | なし | なし | 少数 | 多数 |

| テンポ(拍/分) | 平均(SD) | 189 (31) | 86 (11) | 223 (32) | 151 (53) |

| テンポ(拍/分) | 最小:最大 | 156 : 257 | 68 : 100 | 182 : 274 | 64 : 245 |

| 拍子(刺激に占める割合 %) | 4/4 | 50 | 20 | 60 | 60 |

| 拍子(刺激に占める割合 %) | 3/4 | 30 | 70 | 20 | 20 |

| 拍子(刺激に占める割合 %) | 2/4 | 10 | — | 10 | — |

| 拍子(刺激に占める割合 %) | 複合拍子 | 10 | 10 | 10 | 20 |

| ダイナミクス | 変動幅 | 小さい | 小さい | 小さい | 大きい変動 |

| ダイナミクス | フレーズ冒頭 | 強い | 弱い | 強い | 可変 |

| ダイナミクス | フレーズ終端 | 強い | 弱い | 強い | 可変 |

| ダイナミクス | アクセント付き音数 | なし | なし | 少数 | 多数 |

刺激の録音

すべての刺激は、互いに異なる音色をもつ4種類の楽器、すなわちピアノ(鍵盤/打楽器的音色)、ヴァイオリン(弦楽器音色)、トランペット(金管楽器音色)、電子シンセサイザー(「電子的」音色)で録音された。刺激は「自然」楽器については、音楽院で訓練を受けた2名の経験豊かなクラシック演奏家によって演奏された。ピアノとヴァイオリンの刺激は同一の演奏者(J.H.)が録音した。演奏技法には制約を設けなかった。電子シンセサイザーは、Sibelius v4 (2005) 作曲ソフトウェアを用いて生成した。メロディはト音記号で書かれているため、ピアノ、ヴァイオリン、トランペット、シンセサイザーのいずれでも同じ音域で演奏可能であった。楽器間でテンポや音量に系統差が生じないよう統制した。各感情に対する平均テンポは、作曲者による最初のピアノ録音に基づくメトロノーム速度を演奏者に提示することで統制した。最終刺激セットの長さは9〜31秒(平均17秒)であった。すべての刺激はノートパソコン上にデジタル wave ファイルとして保存し、録音後に平均二乗平方根(RMS)強度レベルを全刺激で固定した。

図中ラベル: happiness = 幸福、sadness = 悲しみ、anger = 怒り、fear = 恐れ。

実験手続き

刺激は Matlab v7.0 (2004) 上で実装した4肢強制選択パラダイムにより、快適な音量でヘッドホンを通して参加者に提示した。参加者は、各メロディが4つの感情ラベル「幸福」「悲しみ」「怒り」「恐れ」のどれを表しているかを選択するよう求められた。課題理解を確認するため、はじめにピアノによる練習例4つを提示した。実験中、成績に関するフィードバックは与えなかった。

各参加者には4ブロックに分けて160刺激を提示した。各ブロックは1種類の楽器で演奏された40個の音楽刺激から構成された。各参加者について、ブロックごとに異なるメロディ順序を用い、同じ感情が3回以上連続しないよう制限したランダム化に基づき、可能な順列の中から順序を選択した。この設計により、同じメロディが続けて提示される間隔が確保され、各ブロックで同一順序が反復された場合に生じうるプライミングを防いだ。

研究は、若年参加者24名、高齢参加者24名を含み、楽器提示順序(period)が4期間クロスオーバー・デザイン(Jones & Kenward, 2003)に従うよう計画された。この設計では、24通りのすべての楽器順序(4 × 3 × 2)を、それぞれ各年齢群で1名ずつが担当することになる。

統計解析

若年群と高齢群それぞれについて別個に適合した一般化線形混合回帰モデル(Verbeke & Molenberghs, 2000)を用い、楽器とターゲット感情が「正答」(実験者が意図した反応)の確率に及ぼす影響を検討した。二値アウトカム(意図された反応 vs. その他の反応)には標準的に用いられるロジスティック・リンクを採用し、同一個人からの反応間の関連を考慮するため、参加者IDをランダム効果として組み込んだ。

基本モデルの予測因子は、楽器、ターゲット感情、period(1, 2, 3, 4)、およびターゲット感情と楽器の交互作用であった。交互作用の全体 Wald 検定を行い、ピアノで演奏された「幸福」メロディに対する意図反応のオッズを基準として、各条件のオッズを推定した。基準カテゴリを「ピアノ上の幸福」にしたのは、ピアノ音色と幸福の概念の双方が、すべての参加者にとって非常に馴染み深いと考えられたためである。楽器平均反応を表す線形結合も各感情について算出し、その合同 Wald 検定によりターゲット感情間の全体差を検討した。同様の手法で楽器間の全体差も調べた。

さらに、(a) 自己申告による音楽訓練年数、(b) 1週間あたりの音楽聴取時間が正答確率に及ぼす効果、およびこれら両因子とターゲット感情の交互作用を検討するため、これらの追加予測因子を基本モデルに組み込んだ。すべての参加者を対象とした解析では、年齢群と、その年齢群と楽器・感情との交互作用を被験者間予測因子として追加し、年齢群間比較ができるよう基本モデルを拡張した。また、音楽的に「ナイーブ」な参加者においても結果が頑健かどうかを確かめるため、正式な音楽訓練歴が1年未満の参加者サブセット(n = 18)に対しても基本モデルを適用した。

結果

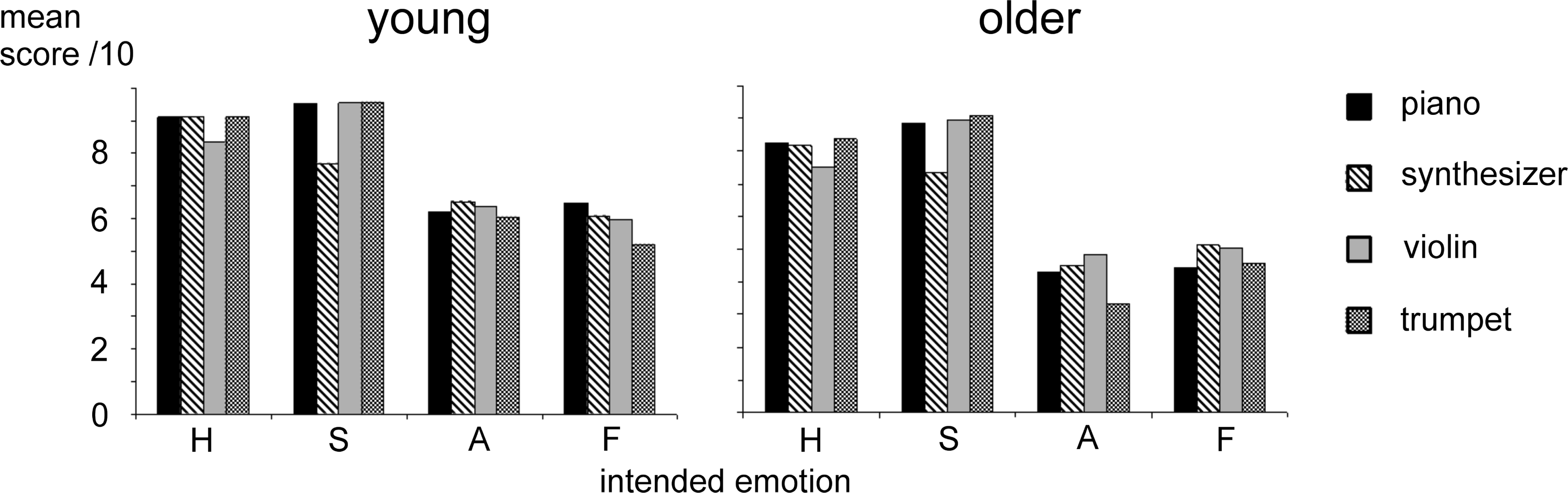

若年参加者では、各ターゲット感情についての平均「正答」数(10点満点)は図2に示し、楽器と感情の各組合せについての「正答」オッズ比(楽器提示順序で調整済み)は、ピアノで演奏された「幸福」メロディに対するオッズを基準として表2に示した。オッズ比が1より大きい場合は、「ピアノ上の幸福」より正答確率が高いことを、1より小さい場合は正答確率が低いことを意味する。95%信頼区間が1を含まない場合、5%水準で統計的に有意である。ただし、可能な対比較の数を考えると、個々の結果の解釈には注意が必要である。厳密には、ここでの参加者反応は、絶対的な基準に対する「正しさ」ではなく、実験者が意図したターゲット感情に対してのみ評価される。

楽器ごとの差の全体検定は統計的に有意だったものの(p = .006)、楽器全体で平均した意図反応確率は各楽器でほぼ同様であった(.74〜.78)。一方、意図反応オッズは感情間で大きく異なった(p < .0001)。平均意図反応確率は「幸福」と「悲しみ」で同程度であり、「怒り」と「恐れ」では著しく低下した。ただし怒りと恐れの同定も、偶然水準を十分上回っていた。各メロディについて、ターゲット感情は最も高頻度に選択された。楽器と感情判断の間には統計的に有意な交互作用が認められた(p < .0001)。「幸福」メロディでは、意図反応オッズはヴァイオリンで他楽器より低く、「悲しみ」メロディでは、意図反応オッズはシンセサイザーで他楽器より低かった。

高齢参加者では、非常によく似たパターンが得られた。平均正答数は図2に、ピアノで演奏された「幸福」メロディを基準とした各条件の意図反応オッズ比は表2に示した。すべての感情カテゴリに平均した場合、意図反応確率は各楽器でほぼ同様(.63〜.66)であり、オッズ差の全体検定は有意ではなかった(p = .14)。一方、楽器平均でみると、「幸福」と「悲しみ」の意図反応確率は類似し、「怒り」と「恐れ」では著しく低下した(感情によるオッズ差の全体検定 p < .0001)。若年群と同様、怒りと恐れの同定は偶然水準を上回っていた。楽器と感情判断の間には有意な交互作用があり(p < .0001)、「幸福」メロディではヴァイオリン、「悲しみ」メロディではシンセサイザー、「怒り」メロディではトランペットにおいて意図反応オッズが他楽器より低かった(各 p < .05)。

2つの年齢群を比較すると、若年参加者は高齢参加者よりも、感情カテゴリ・楽器をまたいで意図反応を示す確率が有意に高かった(p < .0005)。また年齢と感情の交互作用も形式上有意であった(p = .03)。この年齢×感情交互作用は主として、高齢成人が怒り(およびある程度は幸福)の認識で相対的に低成績だったことを反映していた(図2参照)。ただし統計的有意性が境界的であるため、この結果は慎重に解釈すべきである。

年齢群内および群間には、成績にかなりの個人差が存在した。この個人差には、音楽訓練年数や1週間あたりの音楽聴取時間が関係している可能性があると考えた。両年齢群の参加者の大多数はもはや定期的に演奏していなかったため、週当たりの演奏時間はモデル化しなかった。音楽訓練年数と現在の週当たり聴取時間を取り入れてモデルを拡張すると、年齢の主効果は弱まったが依然として有意であった(p = .006)。しかし年齢と感情の交互作用はもはや統計的有意に達しなかった。このモデルでは音楽訓練の主効果と、音楽訓練と感情判断の交互作用が認められた(p < .01)。音楽訓練年数が長いほど正答オッズは上昇し、この上昇は「幸福」メロディで最も顕著で、次いで「怒り」メロディで目立った。週当たり聴取時間にはそのような効果はなかった。

年齢群をまたいで、音楽訓練歴1年以下の参加者のみを対象にしたモデル(n = 18)でも、若年群・高齢群を個別に適合させた結果と類似した結果が得られた。年齢および感情による同様の傾向が見られ、年齢と感情判断の交互作用は非常に有意であった(p < .0001)。

図中ラベル: mean score /10 = 平均得点(10点満点)、young = 若年、older = 高齢、intended emotion = 意図された感情、piano = ピアノ、synthesizer = シンセサイザー、violin = ヴァイオリン、trumpet = トランペット。

| 参加者群 | 楽器 | 幸福 OR | 幸福 CI | 悲しみ OR | 悲しみ CI | 怒り OR | 怒り CI | 恐れ OR | 恐れ CI |

|---|---|---|---|---|---|---|---|---|---|

| 若年 | ピアノ | 1 | — | 1.92 | 0.89, 4.12 | 0.15 | 0.08, 0.25 | 0.16 | 0.10, 0.28 |

| 若年 | シンセサイザー | 1.01 | 0.52, 1.95 | 0.31 | 0.18, 0.54 | 0.17 | 0.10, 0.29 | 0.14 | 0.08, 0.24 |

| 若年 | ヴァイオリン | 0.48 | 0.27, 0.86 | 2.14 | 0.97, 4.72 | 0.16 | 0.09, 0.27 | 0.13 | 0.08, 0.22 |

| 若年 | トランペット | 1.04 | 0.54, 2.01 | 2.21 | 1.00, 4.87 | 0.14 | 0.08, 0.23 | 0.10 | 0.06, 0.16 |

| 高齢 | ピアノ | 1 | — | 1.63 | 0.96, 2.74 | 0.15 | 0.10, 0.23 | 0.16 | 0.10, 0.24 |

| 高齢 | シンセサイザー | 0.93 | 0.58, 1.50 | 0.57 | 0.36, 0.88 | 0.16 | 0.10, 0.24 | 0.21 | 0.13, 0.32 |

| 高齢 | ヴァイオリン | 0.62 | 0.40, 0.97 | 1.83 | 1.07, 3.13 | 0.18 | 0.12, 0.28 | 0.20 | 0.13, 0.31 |

| 高齢 | トランペット | 1.09 | 0.67, 1.77 | 2.12 | 1.22, 3.71 | 0.10 | 0.06, 0.15 | 0.17 | 0.11, 0.25 |

注. 「正答」= 実験者が意図した反応、OR = 意図反応のオッズ比、CI = 95%信頼区間。

考察

これらの結果は、音色(楽器同一性)が健常参加者における音楽感情知覚に影響することを示している。知覚感情と楽器同一性の相互作用は、「正答」水準そのものには依存していなかった。メロディは新規に作成されたものであったため、この効果を特定の楽器と特定のメロディとの既学習連想に帰することはできない。若年成人と高齢成人の双方で類似した結果パターンが観察され、音楽経験に関わる要因(音楽訓練年数および現在の推定聴取量)を統制した後でも効果は残った。さらに、この効果は正式な器楽訓練が1年未満の参加者サブセットでも観察された。これらの所見は、この効果が先行する音楽的熟達性によって決まるものではないことを裏づけている。

本研究の知見は、音色が音楽感情判断に影響しうることを示唆してきた先行研究(Balkwill & Thompson, 1999; Behrens & Green, 1993; Gabrielsson & Juslin, 1996; Juslin, 1997)を支持し拡張するものであるが、以前に報告されたいくつかの特定の楽器-感情相互作用をそのまま再現したわけではない。たとえば、Behrens and Green (1993) の先行研究では、若年健常参加者は、トランペットで演奏された即興よりもヴァイオリンで演奏された即興において、悲しみと恐れの認識がより正確であることが報告されていた。こうした見かけ上の不一致は、少なくとも部分的には方法論的差異に起因すると考えられる。Behrens and Green (1993) の研究では、演奏者が旋律内容を自由に即興できたため、音楽の構造特性(旋律、音域、テンポ、ダイナミクス、振幅レベル)や、感情全体にわたる正答水準が統制されていなかった。加えて、用いた楽器も異なり、反応は強制選択のカテゴリ判断ではなく Likert 尺度に基づいていた。

特定の楽器が感情知覚をどのように調節するかという効果は、それらが占める多次元的な音色空間と、実在楽器の音に埋め込まれた特定の音色成分の感情的性質を事前に予測することの難しさゆえに、解釈が容易ではない。本研究では、ヴァイオリンが「幸福」メロディの同定オッズを低下させ、電子シンセサイザーが「悲しみ」メロディの同定オッズを低下させた。シンセサイザーと他楽器の違いは、自然楽器に対して人間の演奏者が付加した表情手がかりに起因している可能性も原理的にはある。こうした要因が感情判断に寄与することはこれまでにも示されている(Gabrielsson & Juslin, 1996; Juslin, 2000, 2001)。この問題は第2実験で明示的に扱う。

参加者の間には、特定メロディが伝える感情について全般的な一致が見られた一方で、高齢成人は若年成人に比べ、あるメロディに対してターゲット感情ラベルを選ぶ可能性が全体として低かった。年齢群間のこの全体差は、音楽訓練年数や1週間あたりの音楽聴取時間を調整しても消失せず、さらに高齢成人の方がクラシック音楽を日常的に聴いている割合が高かったことから、メロディの作風に帰することも考えにくい。これは、生涯発達の過程で音楽感情を認識する能力に系統的な低下が生じる可能性を示唆し、他モダリティにおける感情認識の加齢効果に関する知見(Calder et al., 2003; Fischer et al., 2005)と概ね整合する。

しかし、音楽における感情同定に対する年齢の交互作用、すなわち高齢成人が怒りおよびある程度は幸福の認識で相対的に低かったという結果は、正式な音楽訓練の期間の影響によって完全に説明された。これは、音楽訓練が、旋法、調、アーティキュレーション、アクセント(Juslin, 2000)など、音楽中の特定感情を同定するうえで重要な特徴の識別を促進する可能性を示唆し、音楽感情の同定精度が熟達によって向上しうるという証拠(Balkwill & Thompson, 1999; Juslin, 2000; Sloboda, 1991)と一致する。

実験2

馴染みのある楽器において、旋律の感情知覚が音色の影響を受けることが確認されたので、次に、馴染みのない合成音色を用いる新たな参加者群でこの知見を再現することを試みた。本実験の目的は2つあった。第1に、先行研究(Gabrielsson & Juslin, 1996; Juslin, 1997; Sloboda, 1991; Sloboda & O’Neill, 2001)に基づき、特定の音楽感情を伝えると予測される音色手がかりを取り込んだ新規音色を作成することであった。これらの新規音色は、実在楽器との近似を避けつつ、複雑で知覚的に区別可能なものとし、特定楽器に対する既学習の感情連想の影響を最小化することを目指した。第2に、合成刺激を用いることで、人間の演奏者が付加しうる微細なダイナミクスやテンポ操作のような効果を除去し、それらが感情的インパクトを変調する可能性を取り除くことであった。

方法

参加者

第1実験には参加していない健常若年成人18名(女性13名、19〜28歳、平均年齢24.3歳、SD = 2.6)を募集した。参加者に職業音楽家はいなかった。参加者特性(要請に応じて提供可能)は、第1実験の若年群と同程度であった。

刺激

4つの新規音色を Matlab を用いてデジタル生成した。音色は、倍音構成、スペクトル包絡形状、時間包絡の「アタック」、および時間変調速度と深さ(ビブラート)を指定することで定義し、Warren, Jennings, and Griffiths (2005) の手続きを用いた。各音色の特徴を表3に示す。音色特性は、特定の音楽感情と関連づけられてきたため(Gabrielsson & Juslin, 1996; Sloboda & Juslin, 2001)、新規音色を設計する際には、スペクトル構成(スペクトル包絡)、アタック、ビブラート(時間包絡)の主要特性を操作することを目指した。

これら4つの合成楽器音は、これらの音色パラメータを体系的に変化させることで、知覚的に区別可能な音色を作る意図で設計された。音色を定義するために使える時空間スペクトル・パラメータの空間は非常に広大であり、実在楽器は知覚的には区別可能であっても構成音色パラメータを共有している(Caclin et al., 2005; McAdams, 1993; McAdams & Cunible, 1992)。そのため、新規合成音色がどのように知覚されるかを正確に予測することは難しい。ここでは、音楽において表出感情を区別することが示されてきた音色特徴の組み合わせを用いた。新規音色1と3(表3)は、低次倍音に強いエネルギー(「くすんだ」質感を伝える)、遅いアタック、遅く浅いビブラートといった、悲しみと関連づけられてきた特性を含む。他方、音色2と4は、高次倍音に強いエネルギー、「切れ込みのある」スペクトル(明るいあるいは「けばけばしい」質感を伝える)、より速いアタック、さらに速いビブラートなど、怒りや幸福、あるいは怒りや恐れと関連づけられてきた特性を含んでいた。

この4つの合成音色を用いて、第1実験で使用した各メロディに対応するデジタル wave ファイルを作成した。得られた刺激は、音高(f0)値、リズム、テンポ、平均強度レベルの点で、第1実験の刺激と同一であった(例は要請に応じて提供可能)。

| 音色特性 | 音色1 | 音色2 | 音色3 | 音色4 |

|---|---|---|---|---|

| スペクトル内容 | 中低域周波数が強い | 高域周波数が強い | 低域周波数が強い | 倍音が少なく、「切れ込みのある」スペクトル包絡 |

| 時間包絡 | アタック・減衰ともに遅い | アタックは速く、減衰は遅い | アタックは遅く、減衰は速い | アタック・減衰ともに速い |

| ビブラートの速度と深さ | なし | 速く、中程度の振幅 | 遅く、小さい振幅 | 速く、大きい振幅 |

実験手続き

第1実験と同様の方法を用い、各参加者には4つの「合成音色」ブロックに分けて160刺激を提示した。各ブロック内でのメロディ提示順は、第1実験と同じ原理に従った。ただし、第2実験の参加者は18名であったため、合成音色の24通りの順序のうち18通りのみを使用した。これらは、楽器と period ができるだけ均衡するよう選択された。

統計解析

データは実験1で記述した基本モデルを用いて解析した。加えて、合成音色に対する参加者の反応が、合成音色と実在楽器との類似性によって駆動されていないことを確かめたかった。そのため、本実験終了後に、5年以上の音楽訓練を受けた11名の音楽経験者に対し評価を実施した。彼らには、4つの新規音色それぞれで「幸福」メロディを演奏した刺激を提示し、各合成音色がピアノ、ヴァイオリン、トランペット(実験1の対象楽器)、クラリネット(広く用いられる管楽器)、あるいは参加者自身が挙げるその他の実在楽器のいずれにどれほど似ているかを、0〜4の尺度で評定してもらった。

結果

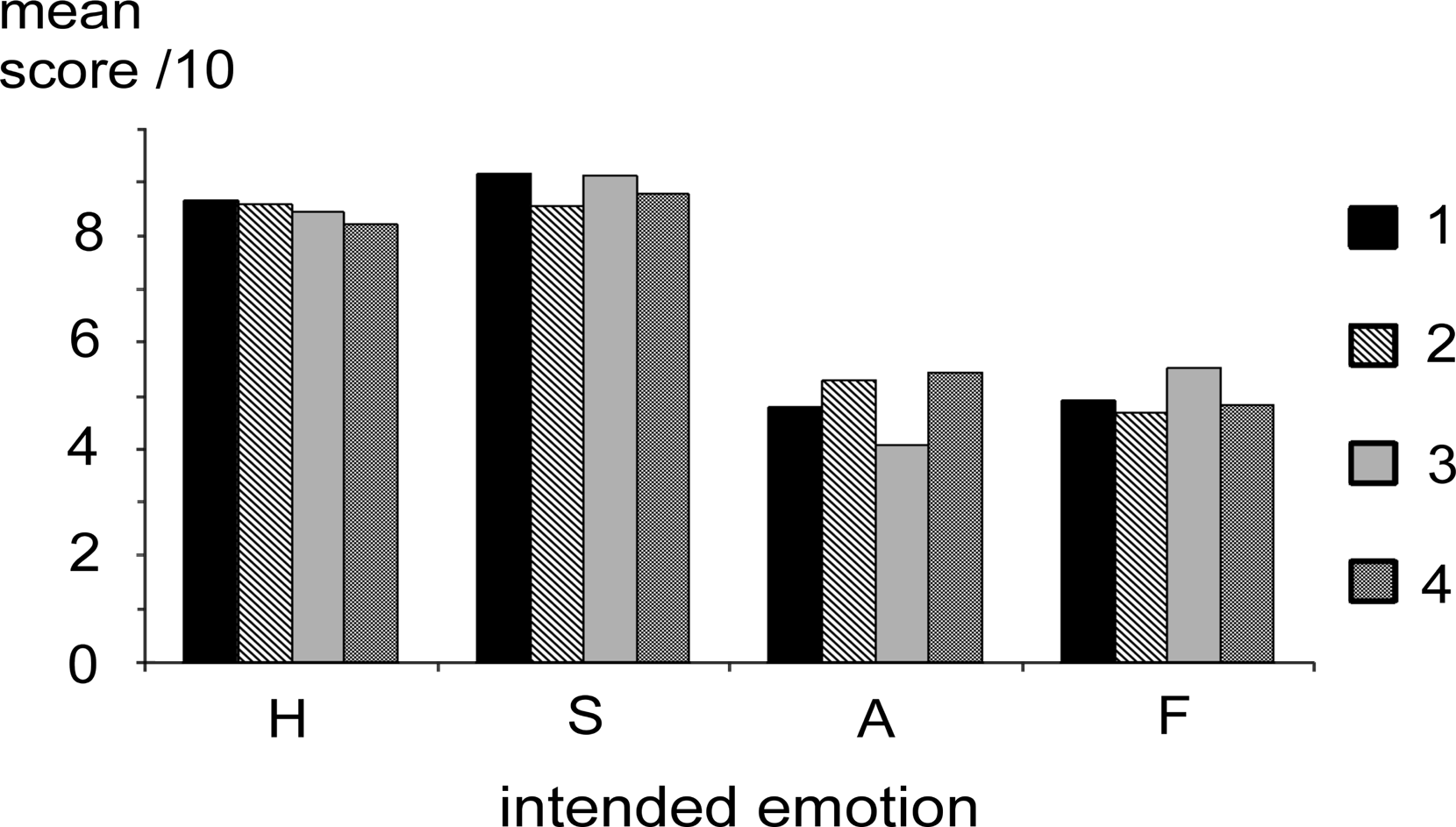

各ターゲット感情についての平均「正答」数(10点満点)は図3に示す。合成音色と感情の各組合せに対する意図反応オッズ比は、方法節で説明したとおり、音色1で演奏された「幸福」メロディに対するオッズを基準とし、表4に示した。結果は実験1と類似していた。すべての感情カテゴリに平均すると、正答オッズは各音色でほぼ同様であり、全体差の検定は有意ではなかった(p = .7)。しかし、意図反応オッズは感情間で大きく異なり、有意であった(p < .0001)。さらに、音色と感情判断の間には統計的に有意な交互作用が認められた(p < .05)。怒りは音色1・3よりも音色2・4で同定されやすく、逆に悲しみは音色2・4よりも音色1・3で同定されやすかった。

新規音色群全体としてみると、11名の音楽経験者は、これらを実在楽器に強く似ているとは評定しなかった。実験者が指定した楽器(ピアノ、ヴァイオリン、トランペット、クラリネット)について、どの音色も平均類似度評定が1.9を超えることはなかった(範囲0〜4)。音色1、2、4については、それぞれ1名または2名の参加者だけが、他の実在楽器にやや似ていると評定した。音色3については、合計5名の参加者がフレンチホルンにやや似ていると評定し、その参加者内での平均評定は2.6であった。

図中ラベル: mean score /10 = 平均得点(10点満点)、intended emotion = 意図された感情、凡例の 1〜4 = 合成音色1〜4。

| 新規音色 | 幸福 OR | 幸福 CI | 悲しみ OR | 悲しみ CI | 怒り OR | 怒り CI | 恐れ OR | 恐れ CI |

|---|---|---|---|---|---|---|---|---|

| 1 | 1 | — | 1.70 | (0.86, 3.36) | 0.14 | (0.08, 0.23) | 0.14 | (0.08, 0.24) |

| 2 | 0.96 | (0.52, 1.75) | 0.91 | (0.50, 1.67) | 0.17 | (0.10, 0.28) | 0.13 | (0.08, 0.22) |

| 3 | 0.83 | (0.46, 1.51) | 1.58 | (0.80, 3.10) | 0.10 | (0.06, 0.17) | 0.18 | (0.11, 0.31) |

| 4 | 0.71 | (0.4, 1.26) | 1.10 | (0.59, 2.05) | 0.18 | (0.11, 0.30) | 0.14 | (0.08, 0.24) |

注. 「正答」= 実験者が意図した反応、OR = 意図反応のオッズ比、CI = 95%信頼区間。

考察

実験2の結果は、実験1の知見を支持し拡張する。すなわち、音楽における音色と知覚感情の相互作用は、新規音色であっても、また演奏者依存の追加的な表情手がかりが存在しない場合でも生じる。ここでの相互作用が、特定音色に対する学習済み感情連想によって駆動された可能性は低い。なぜなら、新規合成音色群は全体として実在楽器に強く似ていなかったからである。この相互作用のパターンは、先行研究が示す、特定の音楽感情に関連する音色特性に関する経験的予測(Gabrielsson & Juslin, 1996; Juslin, 1997; Sloboda & O’Neill, 2001)と概ね整合している。

先行研究では、音楽における特定感情を伝えるうえで、どの音色特徴がどの程度重要かについてかなりのばらつきが示されており、そのため個々の音色パラメータの役割について具体的な結論を下すのは時期尚早である。この留保を踏まえても、音色特性は、実在楽器と合成楽器の双方に関連する感情価を伝えうる可能性が高く(Juslin, 1997, 2001; Juslin & Laukka, 2001, 2003)、少なくともいくつかの基本感情には関与していると考えられる。また、この音色効果の相対的重要性は感情ごとに異なる可能性が高い。たとえば恐れは、テンポやダイナミクスの変化を伴わず、純粋な音色手がかりだけで表現するのが難しいかもしれない(Gabrielsson & Juslin, 1996; Reniscow, Salovey, & Repp, 2004; Robazza et al., 1994; Sloboda & O’Neill, 2001; Terwogt & Van Grinsven, 1988)。

総合考察

以上の2つの実験は、あるメロディが伝える感情の知覚が、それを演奏する楽器の同一性、すなわち音色によって影響を受けることを示している。実験1では馴染みのある音色、実験2では合成音色を用いて、感情カテゴリ判断課題における成績と音色との相互作用を観察した。この相互作用は、音楽の構造的要因(旋律を構成する具体的な音高系列、音量、テンポ、和声的手がかり)、認知的要因(旋律および楽器への馴染み、楽器提示順序)、演奏要因(人間演奏者による演奏か、合成楽器か)といった潜在的交絡要因を統制した後でも認められた。この証拠は、知覚感情と音色の相互作用が、単に低次の音響的・構造的要因や、個人の過去の音楽経験に依存しているのではなく、アタックやスペクトル内容といった音色特性の変化によって直接駆動される頑健な効果であることを示唆する。これは、異文化音楽文脈における音色変化と感情判断の関係を示した先行研究(Balkwill & Thompson, 1999; Balkwill, Thompson, & Matsunaga, 2004)とも整合する。

知覚感情と音色の相互作用は、両実験を通じて、感情ごとに認識しやすさが異なるという主効果と並行して一貫して観察された。悲しみと幸福はよく認識された一方、怒りと恐れはやや認識されにくかった。音色の側面は、旋律や和声のような他の顕著な感情手がかりと相互作用している可能性が高い。通常、音楽は多声音楽であり、複数の楽器パートを含む。そのため、より複雑な音色効果が楽器の組み合わせのレベルで作用し、感情認識を促進している可能性がある(Heaton, Hermelin, & Pring, 1999)。こうした効果は特に怒りと恐れの知覚に関連するかもしれない(Juslin, 2001)。さらに、怒りと恐れはどちらも短調和声や不規則なリズムと関連しており、こうした共通手がかりが、本研究および先行研究で見られた両感情間の相互混同に寄与したと考えられる(Reniscow et al., 2004; Robazza et al., 1994; Terwogt & Van Grinsven, 1988)。日常的な音楽聴取では、恐れは4つのターゲット感情の中で最も表現頻度が低く(Gabrielsson, 2001)、無伴奏の器楽作品ではさらに稀である可能性がある(Reniscow et al., 2004)。こうした個別感情に関する留保はあるものの、第2実験の合成音色は、音色特性がその感情効果に関する経験的・理論的予測(Gabrielsson & Juslin, 1996; Juslin, 1997; Sloboda & O’Neill, 2001)に沿って特異的に操作可能であり、それによって楽曲の感情内容に関する聴き手の判断を偏らせうることを示している。この点は、音色パラメータの巨大な空間を考えれば、今後さらに体系的研究を進める価値が非常に大きい領域である。

音楽における知覚特徴と感情の同定が二重解離するという神経心理学的証拠(Gosselin et al., 2007; Peretz et al., 1998)に基づき、音楽の感情的特徴と知覚的特徴は少なくとも部分的には並列に処理されると提案されてきた。本研究の知見は、健常な聴き手において、これら知覚次元と感情次元の間に重要な相互作用が存在することを示している。さらに、この相互作用は、テンポや強度といったより初歩的な音響特性ではなく、オブジェクト水準の属性である音色のレベルで生じていた。これは、知覚情報と感情情報の相互作用が階層的である可能性を示唆する。すなわち、テンポ、強度、旋法、不協和といった特性の符号化は、音楽におけるポジティブ/ネガティブな感情状態を区別する役割を果たしうるが(Dalla Bella et al., 2001; Juslin, 1997; Peretz et al., 1998)、より精緻な感情弁別は、音色のような高次のオブジェクト属性に依存するかもしれない(Juslin, 2001)。初期知覚分析ののちに、オブジェクト同定と感情処理の機構が相互作用するという、この一部直列・一部並列の構成は、現在の聴覚オブジェクト処理モデル(Griffiths & Warren, 2002, 2004)および健常者の機能的脳画像研究から得られつつある証拠(Blood & Zatorre, 2001; Koelsch, Fritz, Von Cramon, Muller, & Friederici, 2006; Menon & Levitin, 2005; Olson, Plotzker, & Ezzyat, 2007)とも整合的である。

楽器音色という、聴覚オブジェクトの主要属性が感情価に影響することは、異なる文脈における他の複雑音の処理にも広く関係する可能性がある。音楽における音色を処理する脳機構は、音声の表象と評価のために進化したと論じられてきた(Juslin & Laukka, 2003)。音色特性がいかにして音楽的な感情含意を獲得するのかについては、いくつかの理論的機序が考えられる。たとえば、音楽音色は、声の感情表出と音響的特徴を共有しているかもしれない(Juslin & Laukka, 2001, 2003)。音楽における音色特徴は、時間特性としてのアタックを通じて表情的輪郭を、低周波成分・高周波成分のようなスペクトル特性を通じて表情的質感を表す可能性がある。たとえば、音楽における「くすんだ」スペクトル的質感は悲しみと関連し、高周波成分が目立つことで生じる「けばけばしい」質感は怒りと関連する(Juslin, 2001)。こうした関係は、音楽における他の構造手がかりによる感情表現、音声感情表現、さらには身ぶりなど他モダリティでの感情表現にも一般化しうる(Sloboda & Juslin, 2001)。音楽的手がかりの解釈は、非音楽文脈における「感情知能」を促進する、あるいはそこに寄与する可能性もある(Reniscow et al., 2004)。また、音色と感情処理機構の異常な結合は、Williams 症候群(Levitin, Cole, Lincoln, & Bellugi, 2005)、側頭葉てんかん(Boeve & Geda, 2001; Rohrer, Smith, & Warren, 2006)、前頭側頭葉変性症(Boeve & Geda, 2001)などで観察される、音楽や環境音に対する情動反応の変化に寄与している可能性がある。

原稿初稿受理日: 2007年6月26日

改訂稿受理日: 2008年12月18日

オンライン初出日: 2009年4月17日

参考文献

- Balkwill, L. L., & Thompson, W. F. (1999). 音楽における感情知覚の異文化的検討: 心理物理学的手がかりと文化的手がかり。Music Perception, 17, 43-64.

- Balkwill, L. L., Thompson, W. F., & Matsunaga, R. (2004). 日本人聴取者による日本・西洋・ヒンドゥスターニー音楽の感情認識。Japanese Psychological Research, 46, 337-349.

- Behrens, G. A., & Green, S. B. (1993). 声および3種類の異なる楽器による独奏即興の感情内容を同定する能力。Psychology of Music, 21, 20-33.

- Blood, A. J., & Zatorre, R. J. (2001). 音楽に対する強い快反応は、報酬と感情に関与する脳領域の活動と相関する。Proceedings of the National Academy of Sciences, USA, 98, 11818-11823.

- Boeve, B. F., & Geda, Y. E. (2001). ポルカ音楽と意味性認知症。Neurology, 57, 1485.

- Bregman, A. S., Levitan, R., & Liao, C. (1990). 聴覚成分の融合: 振幅変調周波数の効果。Perception & Psychophysics, 47, 68-73.

- Caclin, A., McAdams, S., Smith, B. K., & Winsberg, S. (2005). 音色空間次元の音響相関: 合成音を用いた確認的研究。Journal of the Acoustical Society of America, 118, 471-482.

- Calder, A. J., Keane, J., Manly, T., Sprengelmeyer, R., Scott, S., Nimmo-Smith, I., et al. (2003). 成人期全般にわたる顔表情認識。Neuropsychologia, 41, 195-202.

- Copland, A. (1957). What to Listen for in Music(改訂版)。New York: Signet Classics.

- Dalla Bella, S., Peretz, I., Rousseau, L., & Gosselin, N. (2001). 音楽におけるテンポと旋法の情動価に関する発達研究。Cognition, 80, B1-B10.

- Dowling, W. J., Bartlett, J. C., Halpern, A. R., & Andrews, W. M. (2008). 速いテンポと遅いテンポにおける旋律認識: 年齢、経験、親近性の効果。Perception & Psychophysics, 70, 496-502.

- Ekman, P. (1992). 基本感情を支持する論証。Cognition & Emotion, 6, 169-200.

- Fischer, H., Sandblom, J., Gavazzeni, J., Fransson, P., Wright, C. I., & Backman, L. (2005). 怒った顔の知覚中にみられる年齢差のある脳活動パターン。Neuroscience Letters, 386, 99-104.

- Gabrielsson, A. (2001). 音楽による強い体験における感情。In P. N. Juslin & J. A. Sloboda (Eds.), Music and Emotion: Theory and Research (pp. 431-449). Oxford, UK: Oxford University Press.

- Gabrielsson, A., & Juslin, P. N. (1996). 音楽演奏における感情表出: 演奏者の意図と聴取者の経験のあいだ。Psychology of Music, 24, 68-91.

- Gosselin, N., Peretz, I., Johnsen, E., & Adolphs, R. (2007). 扁桃体損傷は音楽からの感情認識を障害する。Neuropsychologia, 45, 236-244.

- Goydke, K. N., Altenmuller, E., Moller, J., & Munte, T. F. (2004). 感情トーンと楽器音色の変化はミスマッチ陰性に反映される。Cognitive Brain Research, 21, 351-359.

- Griffiths, T. D., & Warren, J. D. (2002). Planum temporale は計算ハブである。Trends in Neurosciences, 25, 348-353.

- Griffiths, T. D., & Warren, J. D. (2004). 聴覚オブジェクトとは何か。Nature Reviews Neuroscience, 5, 887-892.

- Heaton, P., Hermelin, B., & Pring, L. (1999). 自閉スペクトラム障害の子どもは音楽の感情を知覚できるか: 実験的検討。Psychological Medicine, 29, 1405-1410.

- Jackendoff, R., & Lerdahl, F. (2006). 音楽能力: それは何であり、何が特別なのか。Cognition, 100, 33-72.

- Jones, B., & Kenward, M. G. (2003). Design and Analysis of Cross-over Trials(第2版)。London: Chapman & Hall/CRC Press.

- Juslin, P. N. (1997). 短い旋律の合成演奏における知覚された感情表出: 聴取者の判断方略の把握。Musicae Scientiae, 2, 225-256.

- Juslin, P. N. (2000). 音楽演奏における感情伝達の手がかり利用: 演奏と知覚の関係。Journal of Experimental Psychology: Human Perception and Performance, 26, 1797-1813.

- Juslin, P. N. (2001). 音楽演奏における感情伝達: レビューと理論的枠組み。In P. N. Juslin & J. A. Sloboda (Eds.), Music and Emotion: Theory and Research (pp. 309-337). Oxford, UK: Oxford University Press.

- Juslin, P. N., & Laukka, P. (2001). 意図された感情強度が、音声感情表出における手がかり利用と解読精度に及ぼす影響。Emotion, 1, 381-412.

- Juslin, P. N., & Laukka, P. (2003). 音声感情表出と音楽演奏における感情伝達: 異なるチャンネル、同じコードか。Psychological Bulletin, 129, 770-814.

- Koelsch, S., Fritz, T., Von Cramon, D. Y., Muller, K., & Friederici, A. D. (2006). 音楽を用いて感情を調べる: fMRI 研究。Human Brain Mapping, 27, 239-250.

- Kohlmetz, C., Muller, S. V., Nager, W., Munte, T. F., & Altenmuller, E. (2003). 右側頭葉病変後に生じた、鍵盤・打楽器音色に対する選択的な音色知覚喪失。Neurocase, 9, 86-93.

- Levitin, D. J., Cole, K., Lincoln, A., & Bellugi, U. (2005). 嫌悪、気づき、魅了: Williams 症候群表現型における聴覚過敏の主張を検討する。Journal of Child Psychology and Psychiatry, 46, 514-523.

- McAdams, S. (1993). 音源と出来事の認識。In S. McAdams & E. Bigand (Eds.), Thinking in Sound: The Cognitive Psychology of Human Audition (pp. 146-198). Oxford, UK: Oxford University Press.

- McAdams, S., & Cunible, J. C. (1992). 音色アナロジーの知覚。Philosophical Transactions of the Royal Society of London. Series B, Biological Sciences, 336, 383-389.

- Menon, V., & Levitin, D. J. (2005). 音楽聴取の報酬: 中脳辺縁系の反応と生理学的結合性。NeuroImage, 28, 175-184.

- Olson, I. R., Plotzker, A., & Ezzyat, Y. (2007). 謎めいた側頭極: 社会的・感情的処理に関する知見のレビュー。Brain, 129, 2945-2956.

- Peretz, I., Gagnon, L., & Bouchard, B. (1998). 音楽と感情: 知覚的決定因、即時性、そして脳損傷後の解離。Cognition, 68, 111-141.

- Reniscow, J., Salovey, P., & Repp, B. (2004). 音楽演奏における感情認識は感情知能の一側面か。Music Perception, 22, 145-158.

- Robazza, C., Macaluso, C., & Durso, V. (1994). 音楽に対する感情反応: 性別、年齢、熟達度による差。Perceptual and Motor Skills, 79, 939-944.

- Rohrer, J. D., Smith, S. J., & Warren, J. D. (2006). 部分てんかん治療後に生じた音楽への渇望。Epilepsia, 47, 939-940.

- Ruffman, T., Henry, J. D., Livingstone, V., & Phillips, L. H. (2008). 感情認識と加齢に関するメタ分析的レビュー: 加齢の神経心理学モデルへの含意。Neuroscience and Biobehavioral Reviews, 32, 863-881.

- Schneider, A. (2001). 音、ピッチ、音階: 民族音楽学における「音高測定」からソノロジー分析へ。Ethnomusicology, 45, 489-519.

- Sloboda, J. A. (1991). 音楽構造と情動反応: いくつかの実証的知見。Psychology of Music, 19, 110-120.

- Sloboda, J. A., & Juslin, P. N. (2001). 音楽と感情に関する心理学的視点。In P. N. Juslin & J. A. Sloboda (Eds.), Music and Emotion: Theory and Research (pp. 71-104). Oxford, UK: Oxford University Press.

- Sloboda, J. A., & O’Neill, S. A. (2001). 日常的な音楽聴取における感情。In P. N. Juslin & J. A. Sloboda (Eds.), Music and Emotion: Theory and Research (pp. 415-430). Oxford, UK: Oxford University Press.

- Stewart, L., von Kriegstein, K., Warren, J. D., & Griffiths, T. D. (2006). 音楽と脳: 音楽聴取障害。Brain, 129, 2533-2553.

- Terwogt, M. M., & Van Grinsven, F. (1988). 子どもと成人による音楽中の感情認識。Perceptual and Motor Skills, 67, 697-698.

- Verbeke, G., & Molenberghs, G. (2000). Linear Mixed Models for Longitudinal Data. New York: Springer.

- Warren, J. D., Jennings, A. R., & Griffiths, T. D. (2005). 人間の脳による音のスペクトル包絡分析。NeuroImage, 24, 1052-1057.